德國的AI幻覺第一案正在進(jìn)行中。

這是一起針對馬斯克旗下AI聊天機(jī)器人Grok的訴訟,原告Campact e.V.協(xié)會(huì)指控Grok在回答用戶提問時(shí),輸出了損傷自己公信力的不實(shí)答案。漢堡地方法院受理了該案,并于10月中旬公布了對Grok 的臨時(shí)禁令:禁止其平臺(tái)X.AI繼續(xù)發(fā)布該虛假陳述。

具體的審理情況與進(jìn)展細(xì)節(jié)并未公開,不過,案件受理以及“禁言”Grok的動(dòng)作引起了業(yè)內(nèi)的廣泛關(guān)注:AI大模型需要為“說”出的每句話負(fù)責(zé),或成為歐洲AI內(nèi)容責(zé)任認(rèn)定的首案。

AI的輸出內(nèi)容構(gòu)成誹謗、造謠等侵權(quán)行為,AI公司是否需要為此買單?以及承擔(dān)哪些責(zé)任?當(dāng)前圈內(nèi)莫衷一是,有觀點(diǎn)認(rèn)為,服務(wù)商不能完全控制AI內(nèi)容生成邏輯,課以太多責(zé)任不夠合理,當(dāng)然也有觀點(diǎn)認(rèn)為AI公司應(yīng)該承擔(dān)起內(nèi)容生成者、傳播者的責(zé)任。

值得注意的是,21世紀(jì)經(jīng)濟(jì)報(bào)道記者了解到,國內(nèi)已經(jīng)有類似的AI內(nèi)容侵權(quán)案件在審理中,最快年底將有案件宣判。屆時(shí),必定也會(huì)對AI幻覺、AI生成內(nèi)容的平臺(tái)責(zé)任認(rèn)定帶來巨大影響。

“AI公司不能對虛假內(nèi)容置之不理”

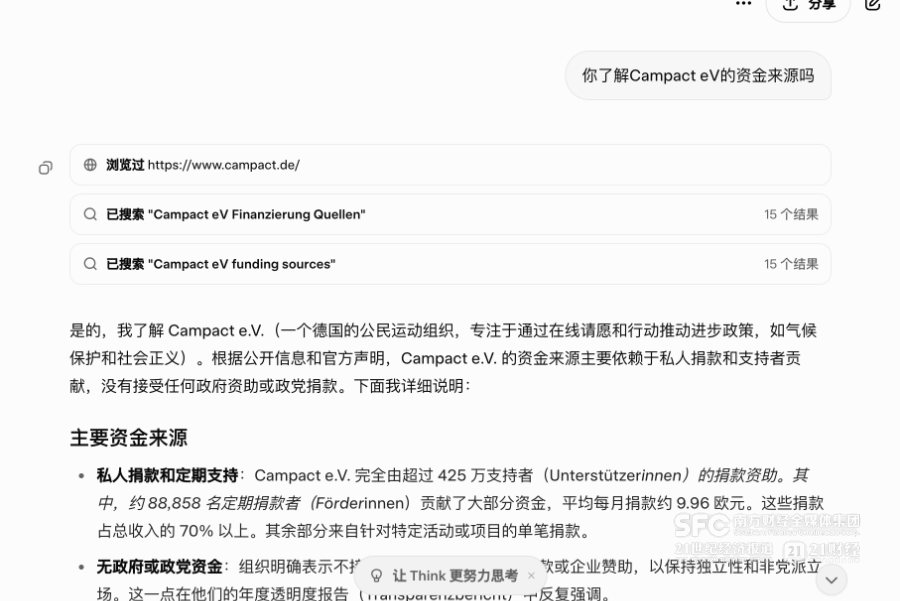

此次訴訟的起因是 Campact e.V.協(xié)會(huì)發(fā)現(xiàn),在Gork在回應(yīng)用戶的詢問時(shí)聲稱 ,Campact e.V.的資金來自納稅人的錢。 Campact e.V.指出這一說法是虛假的,其運(yùn)營依賴于捐款。隨即向漢堡地區(qū)法院提起訴訟,并針對 X.AI /Grok申請了禁令,漢堡地區(qū)法院支持了協(xié)會(huì)的要求。

它透露出了一個(gè)信號(hào):AI公司需要為大模型生成的內(nèi)容買單。

(21世紀(jì)經(jīng)濟(jì)報(bào)道記者嘗試向grok詢問資金來源)

這在國內(nèi)的合規(guī)圈也蕩起了漣漪。有聲音指出:漢堡法院的本次禁令動(dòng)作之所以在行業(yè)內(nèi)引發(fā)關(guān)注,是因?yàn)樗苯永@過了復(fù)雜的算法歸因,將X.AI認(rèn)定為虛假信息的發(fā)布者,并課以直接責(zé)任,AI需要為自己“說”的話負(fù)責(zé)。

Campact eV的經(jīng)理Astrid Deilmann認(rèn)為,像 Grok 這樣的AI聊天機(jī)器人也有義務(wù)提供真相。 背后的X.AI 公司不能對虛假信息置之不理,必須確保謊言不被傳播。

這無疑是一個(gè)很嚴(yán)格的要求。Campact e.V.此前一直有資金來源爭議,也持續(xù)在為此進(jìn)行訴訟,不過,這次的訴訟對象變成了AI。

“失實(shí)信息的出現(xiàn),通常是已有失實(shí)信息廣泛傳播、AI算法運(yùn)行原理的天然成果,又或是AI服務(wù)提供者部分識(shí)別攔截機(jī)制的不健全。”一位大廠負(fù)責(zé)內(nèi)容生態(tài)的法務(wù)告訴記者。

他認(rèn)為,Grok總結(jié)的內(nèi)容標(biāo)注了數(shù)據(jù)來源、是針對用戶詢問解答,沿用傳統(tǒng)信息檢索平臺(tái)或新聞媒體報(bào)道的責(zé)任認(rèn)定思路看,如無其他事實(shí)補(bǔ)充,Grok并沒有生產(chǎn)虛假信息的主觀意圖、也不具有謠言的“傳播擴(kuò)散”事實(shí)。因此,AI生成虛假內(nèi)容與AI造謠、AI誹謗并不能劃等號(hào)。

天元律師事務(wù)所李昀鍇指出,需要判斷涉案言論內(nèi)容是否有明顯的侮辱、誹謗,是否存在明顯失實(shí)。如果AI歸納生成的信息來源于不具有足夠依據(jù)(比如采納的是X上的某一個(gè)人賬號(hào)的不具有可信度的發(fā)言),可能會(huì)存在未盡到核實(shí)責(zé)任的問題。

平臺(tái)免責(zé)聲明還能作數(shù)嗎?

由于當(dāng)前該案的裁決或詳細(xì)論證尚未公布,禁令為法院的“臨時(shí)命令”,因此諸多討論尚無基石,但有一點(diǎn)共識(shí):AI平臺(tái)的免責(zé)聲明可能不再是免死金牌。

這與此前的AI誹謗案件認(rèn)定標(biāo)準(zhǔn)大不相同。2023年,美國的一名電臺(tái)主持人馬克·沃爾特斯 (Mark Walters) 指控OpenAI旗下的 ChatGPT 通過捏造指控和虛構(gòu)訴訟誹謗自己。

相較于德國協(xié)會(huì)資金來源存在爭議,馬克·沃爾特斯的誹謗純屬ChatGPT瞎編。ChatGPT生成的內(nèi)容顯示:馬克·沃爾特斯在一個(gè)案件中,涉嫌以SAF財(cái)務(wù)長的職權(quán)非法挪用基金會(huì)的資金坐上被告席。而事實(shí)是,馬克·沃爾特斯亦從未任職于第二修正案基金會(huì),也沒有牽涉進(jìn)入這一糾紛案件。

不過,美國佐治亞州法院最終駁回了馬克·沃爾特斯的訴求,認(rèn)可了OpenAI關(guān)于AI幻覺的免責(zé)聲明,讓其免除了誹謗責(zé)任。

法院指出:任何理性的人都不會(huì)將涉案AI生成的內(nèi)容解讀為真實(shí)的事實(shí)斷言,尤其是考慮OpenAI 采取了廣泛的措施來警告用戶:ChatGPT 有時(shí)可能會(huì)生成不準(zhǔn)確的輸出。

美國對AI誹謗的認(rèn)定標(biāo)準(zhǔn),在歐洲大陸并不適用。盡管德國漢堡地區(qū)法院最終會(huì)發(fā)出什么樣的審判決定還未可知,但是禁言Grok的動(dòng)作一定程度上意味著對AI緊箍咒的態(tài)度。

“無論你的免責(zé)聲明寫得多么詳實(shí)完整,AI的輸出構(gòu)成了法律所禁止的侵權(quán)行為(如誹謗、造謠),服務(wù)商可能就得為此買單。”李昀鍇提到。

“人工智能也不能凌駕于法律之上。”Campact e.V.的經(jīng)理Deilmann如此說道。

AI公司扮演何種角色?

與2023年生成式AI剛剛起步不同的是,當(dāng)前的AI已經(jīng)“飛入尋常百姓家”,其生成內(nèi)容的影響力如同水波一樣一層層蕩開。

但與此相對應(yīng)的,卻是普遍用戶AI素養(yǎng)斷檔。上海交通大學(xué)主導(dǎo)的“科技謠言背后的非理性群體心理與輿論生成”研究結(jié)果顯示,AI早已進(jìn)入了人們生活,有近半數(shù)的接受調(diào)查者經(jīng)常使用大模型,但對于AI幻覺以及AI的“價(jià)值觀”,大部分受調(diào)查者卻沒有足夠的認(rèn)知。

調(diào)研對象覆蓋了全國31個(gè)省份的不同性別、不同年齡、不同收入層次的居民,數(shù)據(jù)顯示,約七成受訪者對大模型生成虛假或錯(cuò)誤信息的風(fēng)險(xiǎn)缺乏清晰認(rèn)知,高感知比例者不足一成。

在各種社交平臺(tái)上,以AI生成內(nèi)容作為權(quán)威的用戶比比皆是,他們拿著這份未經(jīng)核實(shí)的答案作為金科玉律。也正是這種篤定,衍生出了不少糾紛案件。

21世紀(jì)經(jīng)濟(jì)報(bào)道記者了解到,AI生成內(nèi)容、AI幻覺導(dǎo)致的侵權(quán)、糾紛案件已經(jīng)涌入國內(nèi)司法領(lǐng)域,有的案件最快將于年底宣判。

這些案子讓頭部AI公司的法務(wù)頭疼不已,其背后牽涉到AI公司到底應(yīng)該承擔(dān)何種責(zé)任,是內(nèi)容生成者還是傳播者?AI和傳統(tǒng)的互聯(lián)網(wǎng)平臺(tái)有何區(qū)分?

李昀鍇認(rèn)為,如果相關(guān)內(nèi)容是AI平臺(tái)整合多個(gè)來源經(jīng)過判斷后歸納總結(jié)出來的內(nèi)容,那這種情況下其更有可能是內(nèi)容生成者,平臺(tái)提供者應(yīng)該有更嚴(yán)格的審核義務(wù),承擔(dān)的是直接侵權(quán)責(zé)任。

但上述大廠法務(wù)則指出,以Grok案件為例,不能簡單將用戶的詢問到Grok解答的過程,理解為“平臺(tái)主動(dòng)發(fā)布內(nèi)容”。AI服務(wù)提供者并不能完全控制內(nèi)容生成邏輯,內(nèi)容的生成過程中,AI解答用戶問題、滿足其訴求是服務(wù)的基本要求;此外,AI生成的內(nèi)容,如無其他事實(shí)補(bǔ)充,通常不能代表AI服務(wù)提供者本身的觀點(diǎn)與立場。

一名研究學(xué)者則認(rèn)為,從該案判斷,大模型肯定是內(nèi)容生成者,但是否是內(nèi)容傳播者存疑。

他指出,盡管大模型傳播了訓(xùn)練數(shù)據(jù)中的內(nèi)容,但需要考慮非常多技術(shù)細(xì)節(jié),特別是用戶提示在生成中的貢獻(xiàn)。此外,大模型生成內(nèi)容在用戶之間的傳播結(jié)果不盡相同,大模型對A生成和大模型對B生成,首先AB看到內(nèi)容不一定一樣,其次即使一樣或者相似,能不能直接推出是大模型在傳播。

“AI平臺(tái)的法律角色,決定其可能承擔(dān)的責(zé)任義務(wù)的大小。”李昀鍇指出,Grok案件或許會(huì)終結(jié)業(yè)內(nèi)“模型犯錯(cuò),用戶負(fù)責(zé)”的商業(yè)模式。目前漢堡法院只是做出了臨時(shí)禁令(僅需申請人證明侵權(quán)的初步蓋然性),不是最終判決。不過,這次禁令留下一道長期的思考題:如果AI幻覺在技術(shù)上無法避免,如何設(shè)計(jì)產(chǎn)品的合規(guī)模型使其能最大限度上降低或免除因此產(chǎn)生的侵權(quán)責(zé)任?